【

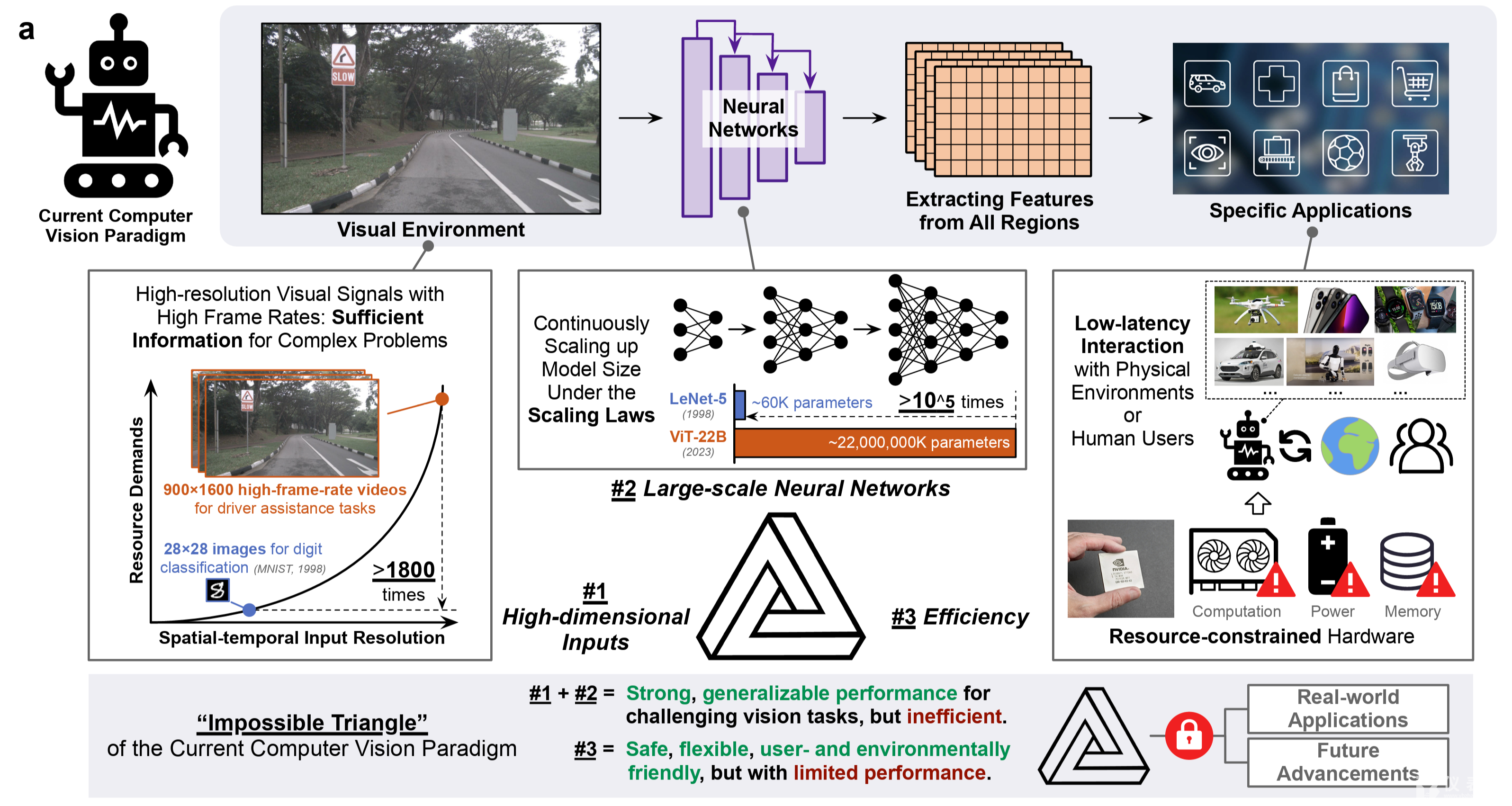

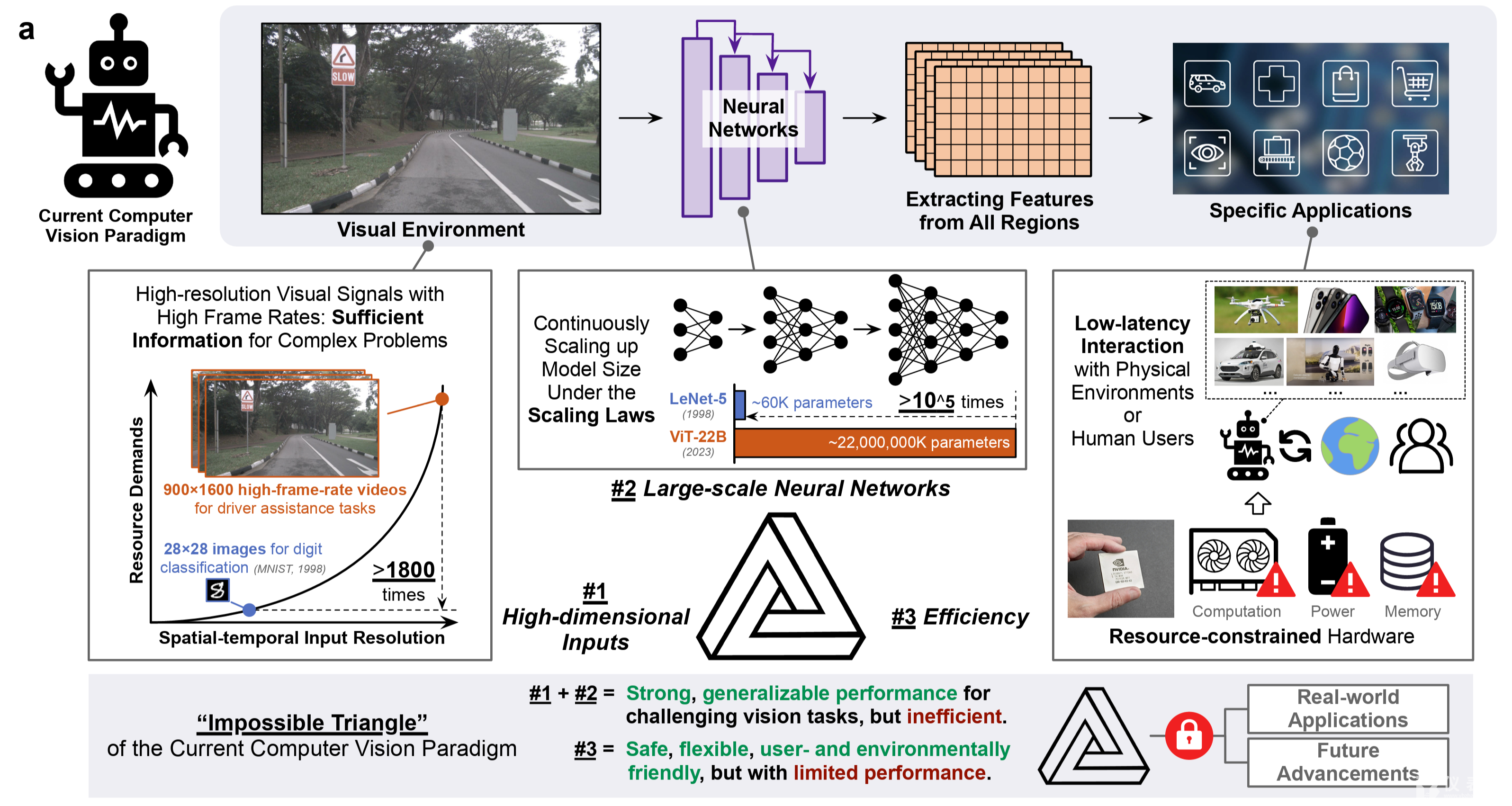

仪表网 研发快讯】过去几十年间,计算机视觉研究取得了突破性进展。然而,深度神经网络驱动的计算机视觉模型在功耗、存储和响应时延等方面存在显著的效率瓶颈,难以广泛部署于机器人、移动设备或边缘终端等资源受限的场景。此外,大型视觉模型巨大的训练与推理开销也使算力瓶颈问题和环境可持续性问题变得尤为突出。

图1.当前计算机视觉范式所面临的能效瓶颈

人类

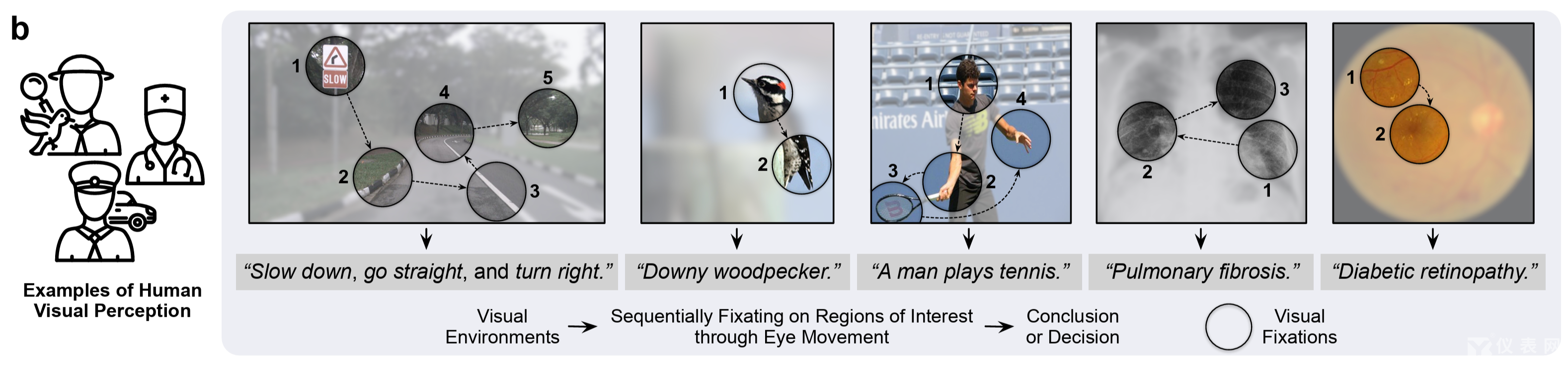

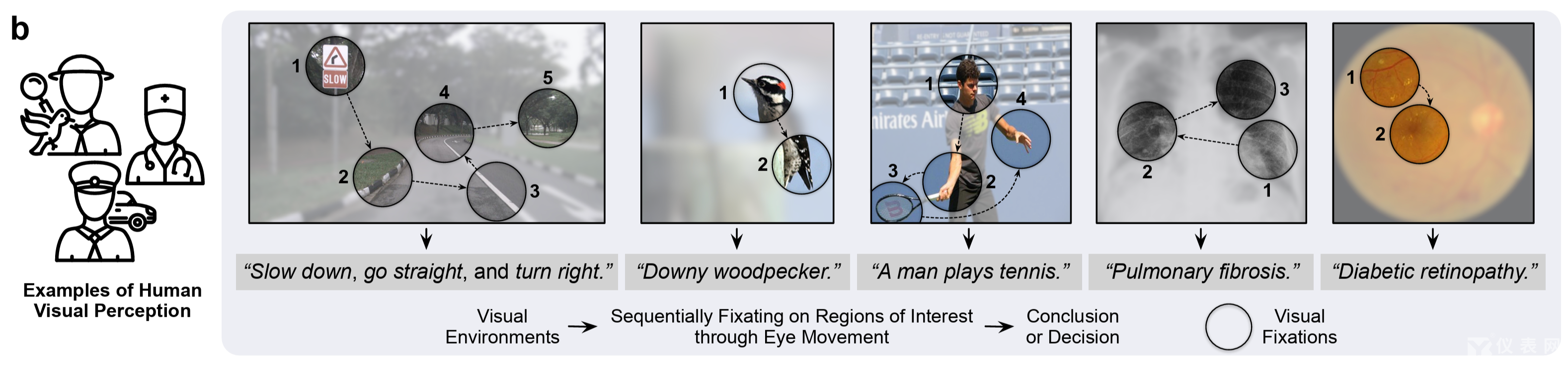

视觉系统能在庞杂的视觉输入中快速筛取要点,大幅降低冗余计算,使得人类高度复杂的视觉系统能够高效、快速运行。无论外界场景多么复杂,人类视觉系统的能耗主要取决于注视带宽与注视次数,而非全局像素量。早在2015年,深度学习三位主要奠基人杨立昆(Yann LeCun)、本吉奥(Bengio)和辛顿(Hinton)便指出,未来的AI视觉系统应具备类人的、任务驱动的主动观察能力。然而近十年以来,这一方向仍缺乏系统性研究。

图2.人类视觉系统的主动自适应感知策略

11月6日,清华大学自动化系宋士吉教授、黄高副教授团队在《自然·机器智能》(Nature Machine Intelligence)上以“模拟人类自适应视觉,实现高效灵活的机器视觉感知”(Emulating human-like adaptive vision for efficient and flexible machine visual perception)为题发表论文,提出AdaptiveNN架构,通过借鉴人类“主动自适应视觉”机制,逐步定位关键区域、累积多次注视信息,并在信息足够完成任务时主动终止感知过程。

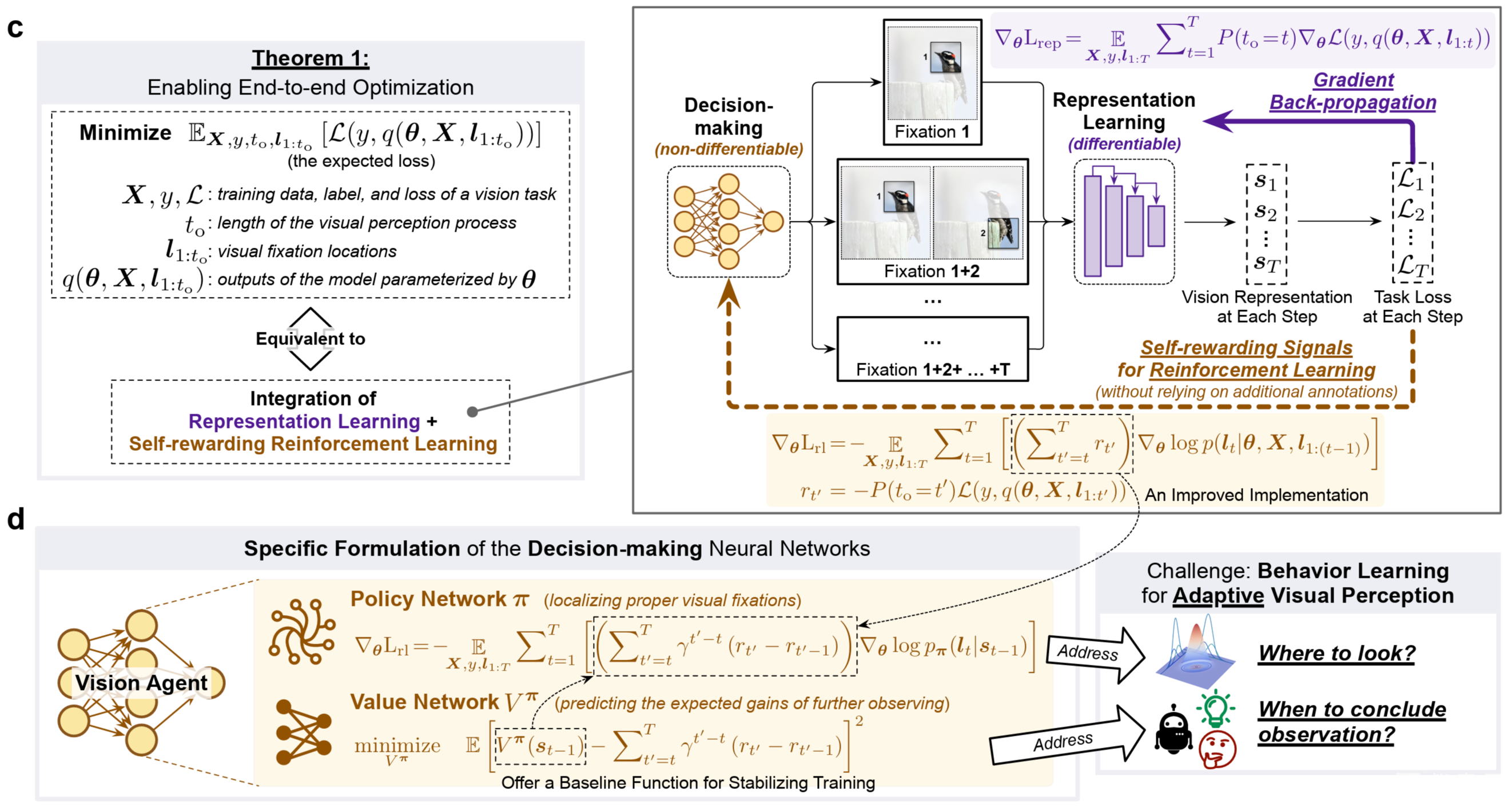

AdaptiveNN模型在一个视觉环境中,依次在若干感兴趣区域上进行“注视”,逐步积累信息形成内部视觉表征,并动态决定何时结束该过程。在每一步,Vision Agent基于当前的内部视觉表征评估任务完成度,若信息不足,则通过策略网络选择下一次注视位置。每个选定的注视区域由表征提取网络提取深度特征,从而不断更新内部视觉表征用于后续决策。AdaptiveNN的整体框架模拟了人类从全局到局部、从粗到细的视觉感知策略,使神经网络具备了类人式的主动感知能力,突破了传统视觉模型的效率瓶颈。

AdaptiveNN在设计上具有较强的兼容性和灵活性,适用于多种不同的深度神经网络基础架构(如卷积网络、Transformer等)和多种任务类型(如视觉识别、具身视觉感知、视觉-语言多模态联合建模等)。

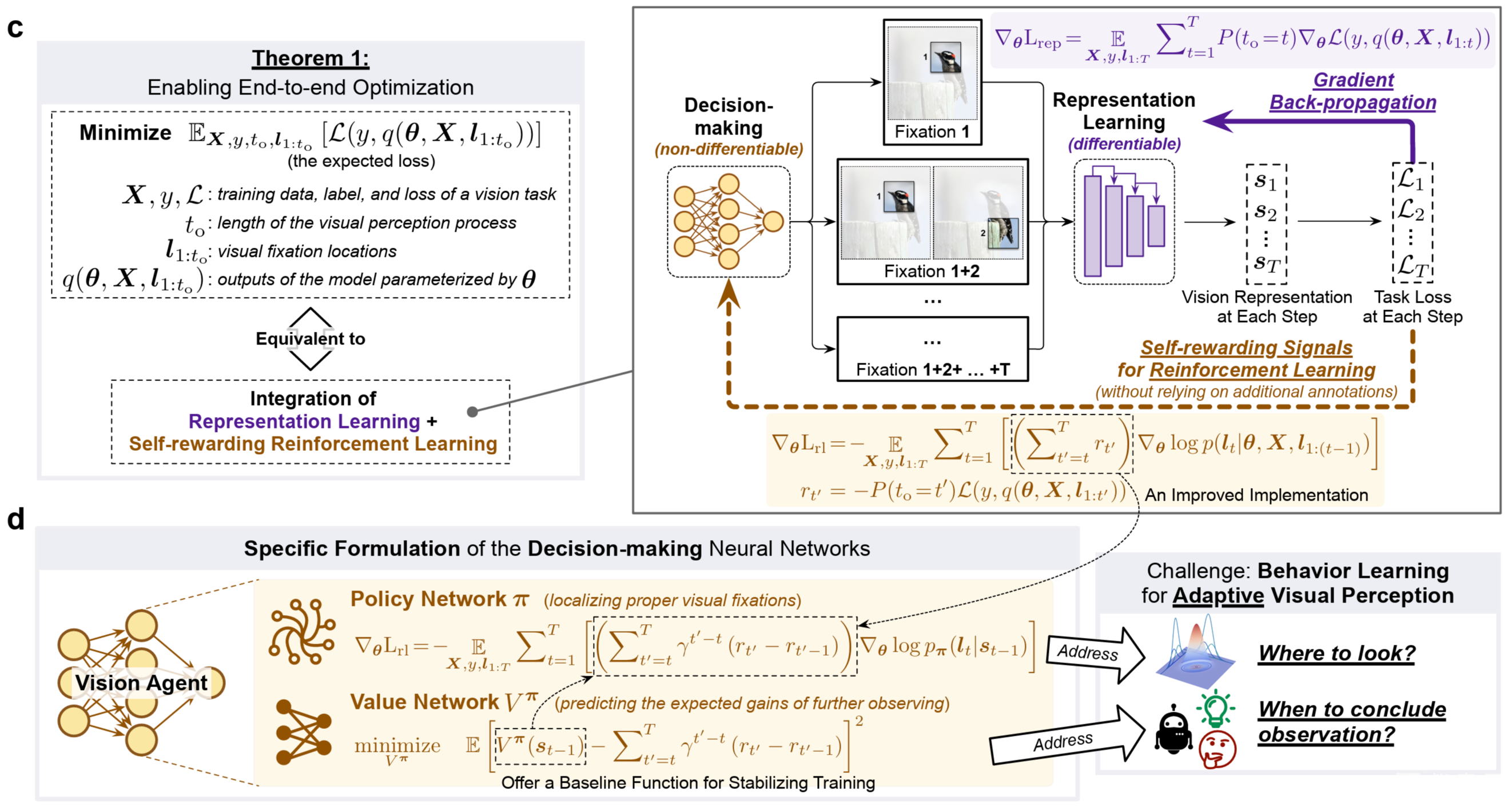

图3.AdaptiveNN的网络架构和推理过程

AdaptiveNN的训练过程同时涉及连续变量(如从注视区域中提取特征)和离散变量(如决定下一次注视位置)的优化。具体而言,从期望优化目标出发,对整体损失函数进行分解,AdaptiveNN的端到端优化过程可自然地分解为两项:第一项为表征学习目标(representation learning),对应于从注视区域中提取任务相关的特征;第二项为自激励强化学习目标(self-rewarding reinforcement learning),对应于优化注视位置的分布,驱使模型的主动注视行为实现最大化的任务收益。这一理论结果揭示了AdaptiveNN的内在学习规律:主动感知的优化本质上是表征学习与强化学习的统一。

图4.自激励强化学习驱动的端到端主动视觉感知行为学习

研究团队在九类典型视觉任务上对AdaptiveNN进行了实测验证,AdaptiveNN展现出了高效、灵活和透明的特点。

图5.ImageNet大规模视觉识别任务上的定性和定量实验结果

研究团队进一步将AdaptiveNN应用于具身智能的基础模型——视觉语言动作模型(VLA)。结果表明,该框架在复杂操作场景中显著提升了具身基础模型的推理与感知效率,在保持任务成功率的同时将计算效率提升4.4至5.9倍。

图6.ApdativeNN应用于VLA具身任务的实验结果

综上,AdaptiveNN提供了一种通用的高效视觉模型,对认知科学的研究具有启发意义,有望用于模拟和检验人类的注意力分配、感知学习以及复杂任务中的视觉决策机制,为认知科学提供新的视角和工具。

清华大学自动化系2019级博士生王语霖,2022级博士生乐洋、乐阳为论文共同第一作者,自动化系教授宋士吉、副教授黄高为论文共同通讯作者。研究得到国家重点研发计划青年科学家项目、国家自然科学基金重大仪器研制项目、联合重点项目等的资助。

所有评论仅代表网友意见,与本站立场无关。